¿Cuál es la Meta? Desafíos para la protección de los Datos Personales desde un enfoque de derechos.

“La inteligencia artificial es la última frontera. Más allá de esta frontera se encuentran beneficios inimaginables para la humanidad, pero también riesgos que amenazan nuestra existencia misma.

Debemos manejar esta tecnología con cuidado, con una visión clara de sus posibles consecuencias, y con un sentido de responsabilidad que nos haga conscientes de nuestros deberes para con las generaciones futuras.”

Stephen Hawking, físico teórico.

Introducción

El objetivo de este informe de IA 2050 es analizar la protección de datos personales ante el avance de la inteligencia artificial (IA) generativa, con el fin de identificar los desafíos que existen, para una regulación integral desde un enfoque de derechos.

Cada vez que interactuamos en la red, ya sea a través de una compra online, una red social o la suscripción a un newsletter, autorizamos la recolección de nuestra información personal sin leer o entender acabadamente los términos y condiciones que estamos aceptando y muchas otras veces, sin siquiera manifestar de manera expresa dicho consentimiento.

A lo que se suma que, el desarrollo de nuevas tecnologías y entre ellas la IA, analizan y utilizan esos datos recolectados de forma automatizada, para la elaboración de perfiles y la toma de decisiones.

El típico ejemplo, es la publicidad personalizada en internet. Cuando navegamos y utilizamos motores de búsqueda, producimos datos que van desde nuestros intereses, ubicación, gustos, e incluso el tiempo que tardamos leyendo o viendo algo. Y, estos datos, son utilizados a través de algoritmos para inferir nuestras preferencias y orientar la publicidad, cuando no para incidir en nuestro comportamiento, lo que se conoce como perfilamiento o elaboración de perfiles -en inglés profiling-.

Otras veces, sólo basta con mencionar verbalmente el producto que se pretende adquirir para que sea captado por el micrófono del dispositivo, haya sido o no nuestra intención activar el motor de búsqueda.

Esta capacidad de inferir datos, genera una profunda preocupación por la afectación a las libertades, a la privacidad y a la seguridad de los datos personales.

Ahora bien, ¿Cómo funcionan u operan los algoritmos? ¿Qué tratamiento realizan? ¿Cuál es la finalidad?, son preguntas que en su mayoría no tienen respuesta. La opacidad en el funcionamiento interno de un algoritmo de IA, es llamado comúnmente como “caja negra”.

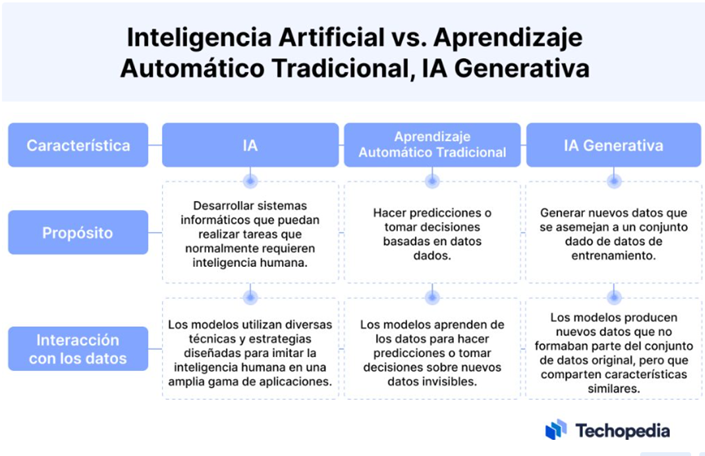

A lo largo de los últimos años, se viene dando un debate a nivel global que ha adquirido en la actualidad más relevancia que nunca. Y ello, responde a la necesidad imperiosa de dar un paraguas jurídico de protección a los datos personales, ante el avance en su utilización, no sólo para procesar datos, sino ahora para alimentar a la inteligencia artificial generativa, que va más allá de analizar y clasificar datos, sino que tiene la capacidad de crear nuevos contenidos.

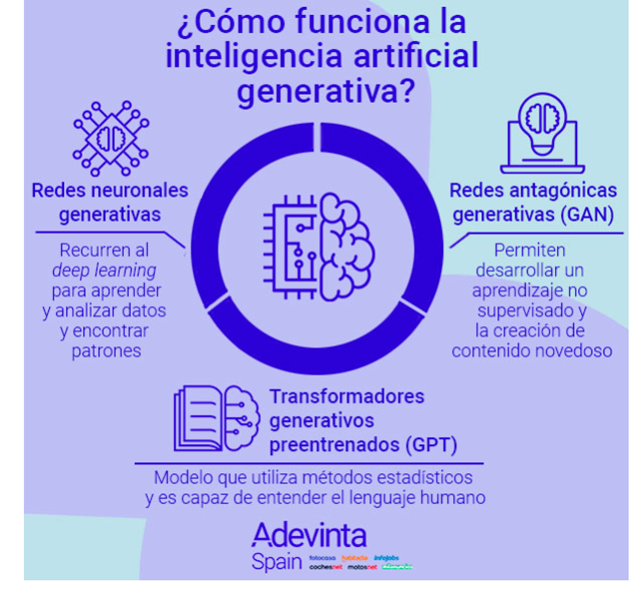

Así, se la ha definido diciendo que “La IA generativa se basa en sofisticados modelos de machine learning denominados modelos de deep learning, es decir, algoritmos que simulan los procesos de aprendizaje y toma de decisiones del cerebro humano. Estos modelos funcionan identificando y codificando los patrones y las relaciones en enormes cantidades de datos, y utilizando después esa información para entender las peticiones o preguntas en lenguaje natural de los usuarios y responder con nuevos contenidos relevantes.”[1]

Las primeras pruebas realizadas por la empresa Meta Platforms Inc., cuyo nombre comercial es “Meta”, no pudieron ser aplicadas en la Unión Europea, ante las prohibiciones de la regulación existente. Pero en Argentina, como consecuencia del vacío normativo, se efectuaron a través de Facebook, Instagram, Messenger y WhatsApp (el famoso círculo azul llamado Meta AI, [3]).

Por ello, ante la amplitud de aspectos que abarca el avance tecnológico que se ha producido en los últimos años y a pasos agigantados, se torna vital contar con una regulación que permita abordar estos nuevos desafíos.

Estado de situación en Argentina

Actualmente hay un vacío legal en la materia. La irrupción de nuevas tecnologías y su inmediata utilización en el cotidiano, no fue acompañada de cambios en el orden legislativo.

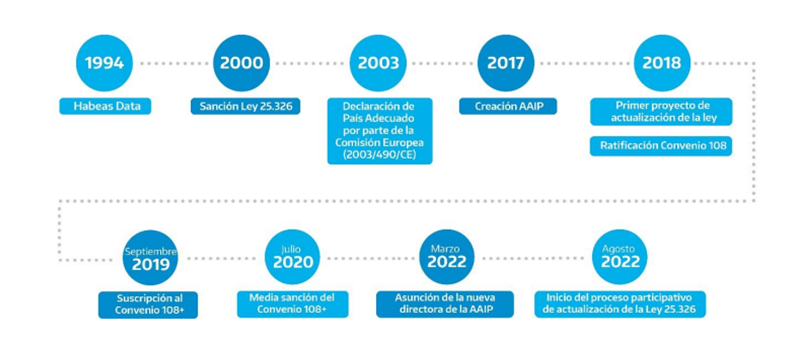

La ley N° 25.326 de Protección de datos personales, que data del año 2000, ha quedado desactualizada.

Y, ante los nuevos avances tecnológicos, se han producidos nuevas formas de vulneraciones a nuestra privacidad y seguridad de datos personales, y hay consensos generalizados en relación a que, la normativa vigente no puede dar las respuestas oportunas a dichas transgresiones, independientemente del sector que se trate (político, académico, empresarial, ONG, etc.).

Esta falta de actualización no es inocua, sino que, por el contrario, decanta en un uso abusivo por parte de las empresas. La recolección de datos se produce mediante un mero aviso o incluso, a través del mero uso de las aplicaciones, lo que ocasiona que los usuarios desconozcan qué datos autorizan a recolectar, para qué, quiénes y con qué fines.

Las políticas de tratamiento de datos personales y sus innumerables actualizaciones en las diferentes apps no son ni leídas ni comprendidas por los usuarios al otorgar el consentimiento, el cual simplemente ha pasado a ser un mero formalismo, pero que, está muy lejos de garantizar la protección efectiva de los mismos. ¿Se puede consentir aquello que no se sabe siquiera que se está consintiendo?, o incluso ¿se puede consentir términos y condiciones que son inconstitucionales?

Se suele señalar, que el uso de algunas plataformas es gratuito, pero lo cierto es que, el uso se paga con la contratación de packs de datos. Los datos y lo que de ellos extrae es valuable económicamente: se cambia uso por datos, y en ello, no hay nada de gratuito. De allí, la tan conocida frase “la información es poder”: si bien este es un concepto que engloba una multiplicidad de análisis posibles, es suficiente para graficar la relación desigual que se da entre las corporaciones que desarrollan e implementan sistemas de IA y el individuo. A lo que se suma, que el desarrollo y la implementación de los sistemas de algoritmos son con bajos o nulos niveles de transparencia, y sin medidas de supervisión o responsabilidad, lo que agrava más la situación descripta.

Por ello, cargar en el individuo la administración y efectividad del ejercicio de su derecho a la privacidad, como sucede en la actualidad, es condenarlo a la vulneración sistemática. Las prácticas actuales, en lo que refiere al consentimiento para la recolección y tratamiento de datos personales, no otorga verdaderas posibilidades de decisión de las personas.

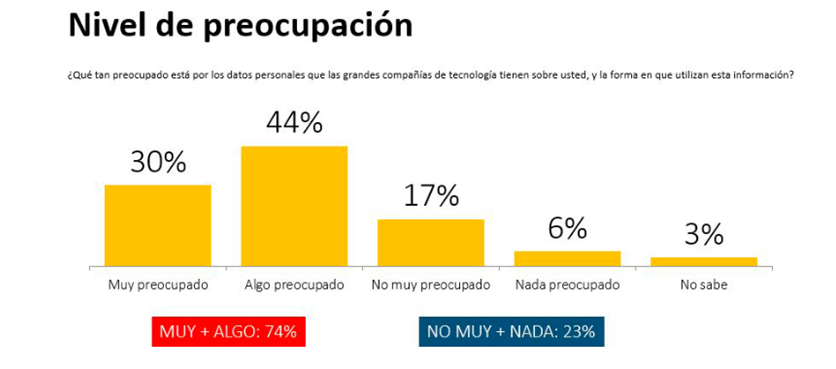

Conforme una encuesta realizada por Amnistía Internacional, en Argentina 3 de cada 4 personas están preocupadas por el uso de los datos personales que hacen las grandes compañías de tecnología. La encuesta, también reveló que, el 80 por ciento de los consultados considera que debe regularse.

Incluso, se ha dicho en este sentido: “Si uno accede a las condiciones de uso y a la política de datos de Meta, que abarca a todas sus empresas controladas podemos observar que, como contraprestación a nuestro uso de las aplicaciones, otorgamos a la empresa una licencia “… internacional, sublicenciable, transferible, libre de regalías y no exclusiva para alojar, usar, distribuir, modificar, ejecutar, copiar, mostrar o exhibir públicamente y traducir tu contenido, así como para crear trabajos derivados de él”. (https://developers.facebook.com/terms/dfc_platform_terms/?locale=es_LA). De la misma manera, la big tech obtiene un permiso para mostrar nuestro nombre de usuario, foto de perfil, información sobre las acciones que realizamos, nuestras relaciones, las cuentas, anuncios y ofertas que seguimos o con los que interactuamos, sin obligación de proporcionarnos compensación alguna. … No es menor el hecho de que la empresa Meta tenga bajo su órbita a Facebook, Instagram, Whatsapp y Oculus. Tan solo estas cuatro empresas poseen acceso a los datos de más de 2500 millones de usuarios de todo el mundo.”[5]

Y si bien, esto por sí solo es suficiente para señalar la necesidad de establecer un marco regulatorio que contemple la implementación de sistema de IA, que involucra una constante absorción de datos, flujo y manejo de la información, la protección de los datos personales en estos contextos es sólo la punta del iceberg.

Por otro lado, hay que desterrar la falsa dicotomía entre la innovación versus la regulación. Es necesario promover y promocionar la innovación tecnológica y el desarrollo de la economía del conocimiento y digital, y, en paralelo, establecer reglas claras desde un enfoque de derechos humanos y en consonancia con los estándares internacionales en materia de protección de datos personales.

Normativa vigente

La intimidad, el honor y la dignidad humana detentan rango constitucional. Así, nuestra Constitución Nacional, consagra la inviolabilidad de la propiedad, el domicilio y la correspondencia privada sin orden escrita y fundada de autoridad pública. A lo que se suma, luego de la reforma constitucional de 1994, la protección de los datos personales a través del hábeas data. Pero, a nivel legal, los avances tecnológicos no pudieron ir de la mano de una normativa que permita abordar estos nuevos desafíos.

Como contrapartida del vacío legislativo señalado, existen disposiciones dispersas. Así, en primer lugar, debemos citar la ya nombrada ley 25.326: de Protección de los Datos Personales; también, la ley 26.388 sobre delitos informáticos, y la ley 26.904 contra el denominado Grooming, ambas modificatorias del Código Penal; la ley 27.078 de Tecnologías de la Comunicación y la Información –más conocida como Ley Argentina Digital- que establece la inviolabilidad de las comunicaciones; la ley 27.570 de Economía del Conocimiento, que tiene entre otros objetivos principales fomentar la investigación, creación, diseño, producción y el desarrollo de tecnologías disruptivas, como es precisamente la IA; y, finalmente, la ley 27.699: Protocolo Modificatorio del Convenio para la Protección de las Personas con Respecto al Tratamiento Automatizado de Datos de Carácter Personal, que aprueba el PROTOCOLO MODIFICATORIO DEL CONVENIO PARA LA PROTECCIÓN DE LAS PERSONAS CON RESPECTO AL TRATAMIENTO AUTOMATIZADO DE DATOS DE CARÁCTER PERSONAL, también conocido como Convenio 108+.

Además, existen disposiciones dispersas en cuerpos normativos, como es el caso del Código Civil y Comercial de la Nación, que en su art. 52, consagra el derecho de toda persona a reclamar la prevención y reparación de los daños sufridos por afectaciones a su “intimidad personal o familiar, honra o reputación, imagen o identidad” o cualquier otra lesión a su “dignidad personal.”

En cuanto a la imagen, establece que se requiere, del consentimiento expreso de la persona para la captación o reproducción de su voz e imagen, con excepción de las producidas en actos públicos, asuntos de interés científico, cultural y educacional, e información sobre acontecimientos de carácter general, entre otros.

En cuanto a regulación internacional, podemos citar a la Recomendación sobre la Ética de la Inteligencia Artificial de la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO), a la que adhirieron una gran cantidad de países, entre los cuales se encuentra la Argentina.

El resto de normativa, es sub legal y de aplicación parcial, como por ejemplo la Disposición 2/2023 de Jefatura de Gabinete de Ministros que estableció las RECOMENDACIONES PARA UNA INTELIGENCIA ARTIFICIAL FIABLE, que si bien, tiene buenas intencionalidades, su aplicación es limitada, pues engloba a quienes formen parte del sector público.

Impacto de los sistemas de IA en la protección de datos personales

El caso más resonante que en los últimos meses ha tomado estado público, es la denuncia presentada contra la empresa Meta Platforms, Inc..

Conforme transcendiera en diversos medios de comunicación, los abogados especialistas Facundo Malaureille y Daniel Monastersky, presentaron una denuncia ante la Agencia de Acceso a la Información Pública (AAIP) para que se intime a la compañía propietaria de Meta AI a que aclare las prácticas de recolección y uso de datos personales y cómo preserva la intimidad de los usuarios.

El tema central de la denuncia, radica en el uso de los datos personales para el entrenamiento de la nueva IA de Meta que, se nutre a través del asistente en las diversas plataformas de Instagram, WhatsApp, Facebook y Messenger.

Entre los requerimientos que se formulan en la denuncia, se incluye información sobre la actualización de la política de privacidad de la plataforma y la evidencia del consentimiento de los usuarios, explicaciones técnicas sobre los procesos de anonimización de datos y garantías de su irreversibilidad, aclaraciones sobre la prevención de la reidentificación de datos anonimizados, detalles sobre el manejo de metadatos y datos sensibles en el proceso de anonimización, y detalles sobre las políticas de retención y destrucción de datos.

Otro de los casos, que ha tenido alta trascendencia pública, es el sistema de reconocimiento facial implementado por la Ciudad Autónoma de Buenos Aires (CABA), actualmente suspendido y declarado inconstitucional[6] y que ha dado lugar al inicio de actuaciones de la Procuraduría de Investigaciones Administrativas (PIA) del Ministerio Público Fiscal, por la existencia de sendas irregularidades en su aplicación y la posible existencia de delitos de acción pública[7].

Este tipo de sistema, no responde al típico sistema de vigilancia que produce imágenes y posteriormente se analizan e interpretan; sino que el “… El sistema de reconocimiento facial es un software que captura una imagen, detecta un rostro, mejora la imagen, alinea el rostro y lo reconoce en relación a otra imagen que tiene guardada. El software precisa entrenarse utilizando algoritmos y una base de imágenes. En definitiva, se trata de tecnología basada en inteligencia artificial, que aprende como cualquier inteligencia. Para ello utiliza descriptores geométricos o puntos de interés en el rostro de una persona (landmarks) y descriptores faciales de textura del rostro codificada por una red neuronal profunda (Deep fase recognition). El software valida si dos fotografías pertenecen a la misma persona en base a una codificación matemática de la información.”[8]

Es decir, la identificación y rastreo de las personas captadas por la IA se produce en tiempo real y, para ello, se recurre a los datos biométricos del Registro Nacional de las Personas sin el consentimiento de su titular. Esto implica que el sistema vulnera la privacidad de las personas, al avanzar sobre datos sensibles sin consentimiento[9], amén de tirar por tierra el art. 19 de la CN[10].

Y este tipo de datos, los biométricos, requieren una protección especial, por lo que debe existir mayor seguridad, confidencialidad, restricciones de acceso, uso y circulación.

Ahora bien, estas prácticas no fueron tenidas en cuenta al sancionar la actual ley de datos personales, por lo que necesariamente y ante los avances producidos en la tecnología y que determinan nuevas formas de vulneración, la normativa debe hacerse eco y regular para proteger. Más aún, cuando este tipo de sistemas de IA son implementados desde y por el Estado.

Siguiendo esa misma línea, pero más reciente en el tiempo, las medidas de ciberpatrullaje y la creación de la Unidad de Inteligencia Artificial aplicada a la Seguridad (UIAAS) dispuestas por las Resoluciones del Ministerio de Seguridad N° 428/2024[12] y Nº 710/2024[13], nuevamente pone en jaque las libertades individuales.

Particularmente en el artículo 4 de la Resolución Nº710/2024, se establece entre las funciones de la UIAAS “patrullar las redes sociales abiertas, aplicaciones y sitios de internet”, y “analizar imágenes de cámaras de seguridad en tiempo real a fin de detectar actividades sospechosas o identificar personas buscadas utilizando reconocimiento facial”.

Y continúa señalando que será de su competencia “utilizar algoritmos de aprendizaje automático a fin de analizar datos históricos de crímenes y de ese modo predecir futuros delitos y ayudar a prevenirlos” y “procesar grandes volúmenes de datos de diversas fuentes para extraer información útil y crear perfiles de sospechosos o identificar vínculos entre diferentes casos”.

Además, señala: “analizar actividades en redes sociales para detectar amenazas potenciales, identificar movimientos de grupos delictivos o prever disturbios”,

Si bien, de la simple lectura puede percibirse que se incurre nuevamente en afectaciones a la libertad, privacidad y al principio de inocencia, como en el Sistema de Reconocimiento Facial implementado por CABA, a dicha gravedad se suma la falta de controles, publicidad del sistema y su funcionamiento, y ni que hablar de los análisis y evaluación de impacto diferenciado. Asimismo, a este avance sobre las libertades individuales se le suma, la capacidad de generar condiciones de autocensura y autoexclusión del espacio de debate público digital.

Mensaje 87/2023 y Proyecto de Ley de Protección de datos personales.

En estos más de 24 años de vigencia de la ley 25.326 de Protección de los Datos Personales, muchas han sido las iniciativas legislativas presentadas que tienden a regular el impacto de las nuevas tecnologías.

Todos los proyectos presentados responden a diferentes signos políticos y han sido abordados de diferentes maneras, sea como proyectos de ley autónomos, sea como modificación de leyes vigentes (tanto de la ley 25.326, como la 27.570.).

Esto indica la existencia de una conciencia común en cuanto a la necesidad de modificación y actualización del marco regulatorio vigente y la vocación por la protección de datos personales, estableciéndola de manera expresa o remitiendo a una regulación específica y al establecimiento de principios éticos y de responsabilidad.

De todos los proyectos presentados, destaca el individualizado como Expte PE-108/23 enviado por el gobierno mandato cumplido 2019-2023 que se encuentra próximo a caducar.

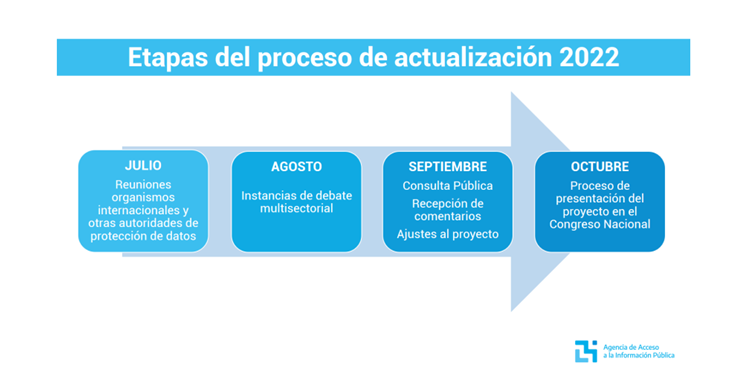

Dicho proyecto, fue el resultado de un arduo trabajo previo, que se dividió en diferentes etapas, tendientes a realizar un proceso participativo.

Así, conforme se desprende de la página oficial: “… la Agencia de Acceso a la Información Pública inició un proceso de debate participativo, abierto y transparente llevando adelante mesas preparatorias y mesas de diálogo con diversos sectores de la sociedad, durante los meses de julio y agosto. Producto de la participación y el debate, se redactó una Propuesta de Anteproyecto que fue presentada el pasado 30 de agosto, en la Cúpula del Centro Cultural Kirchner.

El 12 de septiembre se habilitó la instancia de consulta pública (Resolución AAIP 119/2022) con el propósito de garantizar la efectiva participación de la ciudadanía, de acuerdo con el Reglamento General para la Elaboración Participativa de Normas (Anexo V del Decreto 1172/03). Sin embargo, a raíz de la presentación de distintas solicitudes para extender el plazo de la participación, se prorrogó la consulta pública hasta el 11 de octubre inclusive (Resolución AAIP 145/2022). A lo largo de este proceso se recibieron 173 documentos con opiniones, aportes y comentarios presentados por 123 participantes correspondientes a la ciudadanía en general, organizaciones de la sociedad civil, universidades e investigadores, sector privado y sector público nacional e internacional. Como resultado de este proceso de debate, se presentó un Nuevo Proyecto de Ley de Protección de Datos Personales.”[15]

Es una regulación completa, y es de destacar que, en relación a la ley vigente, es más amplia en cuanto a la posibilidad de tratar los datos personales, pero es más específica en cuanto al consentimiento. Esto responde a la necesidad de aggiornarse a las nuevas formas de relacionarnos y a la importancia que hoy tiene la “big data” y, por el otro lado, el necesario enfoque en derechos humanos.

El origen de este proyecto se remonta a 2018.

En la elaboración la AGENCIA DE ACCESO A LA INFORMACIÓN PÚBLICA (AAIP) tomó como aporte conceptual los más recientes estándares, recomendaciones y lecciones aprendidas en nuestra región y en el mundo durante los últimos años. Incluye a la normativa de la Unión Europea, Brasil, Ecuador, Chile, Paraguay y Costa Rica.

La iniciativa propone actualizar la Ley de Protección de los Datos Personales Nº 25.326, para fortalecer las capacidades estatales de regulación y gestión de políticas públicas para dar respuesta a los nuevos desafíos que imponen las transformaciones tecnológicas y el desarrollo de la economía digital, en armonía con los estándares regionales e internacionales, desde un enfoque de Derechos Humanos y desde una mirada situada y soberana[17].

Se sustenta en 3 pilares:

a) el derecho humano a la protección de los datos personales y la autodeterminación informativa,

b) la innovación tecnológica basada en principios éticos que promueva un desarrollo económico inclusivo y

c) la construcción de confianza a través de reglas de juego claras.

Entre las incorporaciones que realiza, es importante resaltar el principio de extraterritorialidad, que implica que la normativa se aplicará en distintos supuestos, aun cuando los Responsables de tratamiento de datos no se encuentren en territorio nacional.

Además, se establece el Principio de neutralidad tecnológica, es decir, se aplica a cualquier tratamiento de datos personales, con independencia de las técnicas, procesos o tecnologías, actuales o futuras que se utilicen para dicho efecto.

En el Capítulo II se instituyen los principios que se deben respetar para el adecuado tratamiento de los datos personales (artículos 6º a 12 y 20).

Se establecen el principio de licitud, lealtad y transparencia y los principios de finalidad; de minimización de datos; el de exactitud; de preeminencia; de responsabilidad proactiva y demostrada y el de seguridad de los datos personales.

El principio de responsabilidad proactiva, implica que los responsables y otros sujetos que realizan tratamiento de datos se encuentran obligados a demostrar el cumplimiento de la Ley.

En el artículo 13, se determinan las bases legales para el tratamiento de datos. En esto, hay un cambio de paradigma en relación con la ley vigente y se abandona la lógica basada en la prohibición de tratamiento, en caso de no contar con el consentimiento del titular. Pues, se presentan supuestos que legitiman y dan base legal al tratamiento de datos personales. Igualmente, el consentimiento sigue siendo uno de los principios rectores para el tratamiento de datos personales.

Se determinan las características del consentimiento[18], el tratamiento de datos sensibles, el tratamiento de datos en el sector público y la protección especial de datos personales en el caso de niñas, niños y adolescentes.

Se incluyen también previsiones específicas para aclarar el concepto del consentimiento del titular de los datos para su posterior tratamiento (artículos 12, 13 y 14).

Además, se incorporan reglas aplicables a todos aquellos que hacen tratamiento de datos, especialmente la imposición legal de implementación de medidas de seguridad (artículo 20) y la obligación de notificar al titular de los datos y a la autoridad de control ante la ocurrencia de incidentes de seguridad (artículo 21).

El Capítulo 3 refiere a las transferencias internacionales y en sus artículos 23, 24, 25 y 26, establece tres mecanismos con distinto nivel de jerarquía para realizar el flujo transfronterizo de datos personales con confianza. Se refiere a transferencias basadas en una decisión de adecuación; mecanismos que permitan ofrecer las garantías adecuadas o excepciones, que deben darse bajo ciertas condiciones y no pueden utilizarse de manera periódica o habitual.

En el Capítulo 4 de la propuesta, se incluyen los derechos de los titulares de los datos comprendiendo, entre otros, el derecho a saber si se están tratando sus datos personales, figurando allí el derecho de acceso, el derecho de rectificación, el derecho de oposición y el derecho de supresión.

A esos cuatro derechos se agrega el derecho a la portabilidad de datos personales, es decir, el derecho del titular de los datos a solicitar que sus datos personales se transfieran directamente de responsable a responsable cuando sea técnicamente posible (artículo 33).

El proyecto, además, incorpora el derecho a limitación y el derecho sobre las decisiones automatizadas y la elaboración de perfiles.

Asimismo, se incorporan excepciones al ejercicio de los derechos, instituyendo que los derechos y las garantías establecidos, pueden ser limitados en la medida en que ello sea necesario y proporcional para salvaguardar la seguridad pública, la defensa de la Nación, la protección de la salud pública, y las libertades de terceros y en resguardo del interés público.

El Capítulo 5 prevé las obligaciones del Responsable y Encargado de tratamiento, allí se establecen las medidas para el cumplimiento de la responsabilidad proactiva.

El artículo 40 establece que el responsable del tratamiento debe, desde el diseño y antes del tratamiento, prever y aplicar medidas tecnológicas y organizativas apropiadas para cumplir los principios y garantizar los derechos de las personas Titulares de los datos.

Se incorporan la figura del Delegado de Protección de Datos (Artículo 44), la evaluación de impacto relativa a la protección de datos (Artículo 41) y los mecanismos de regulación vinculantes (Artículo 48).

Además, se incorpora, en el artículo 46, la figura del Representante para aquellos Responsables y Encargados que no estén establecidos en la REPÚBLICA ARGENTINA y la ley resulte de aplicación. Asimismo, en el artículo 47 se crea el REGISTRO NACIONAL PARA LA PROTECCIÓN DE LOS DATOS PERSONALES.

El capítulo 6 es relativo a la protección de datos de información crediticia.

Los Capítulos 7 y 8 refieren a la Autoridad de Aplicación y a los procedimientos y sanciones a implementar en caso de constatar el incumplimiento de la ley. En relación a las multas, incorpora una unidad móvil sujeta a la variación del IPC y eleva los montos sustantivamente. Hay que tener en cuenta que las multas actuales son de mil pesos ($ 1.000.-) a cien mil pesos ($ 100.000.-).

El Capítulo 9 regula específicamente la acción judicial de habeas data. La mayor innovación consiste en la ampliación de la legitimación activa para acciones colectivas.

En el Capítulo 10 se establecen las Disposiciones Complementarias, y se determina que las normas de la presente ley son de orden público y de aplicación en todo el territorio nacional, con excepción de las normas procesales del Capítulo 9 que, se regirán por lo establecido en los respectivos ordenamientos provinciales, e invita a las Provincias y a la Ciudad Autónoma de Buenos Aires a adherir.

Se modifica la denominación del Capítulo IV del Título I de la Ley N° 27.275 y su modificatoria, renombrando a la Autoridad de Aplicación bajo el título “AGENCIA DE ACCESO A LA INFORMACIÓN PÚBLICA Y PROTECCIÓN DE LOS DATOS PERSONALES”; se sustituyen los artículos 19 y 29 respectivamente de la referida Ley N° 27.275 -Derecho de Acceso a la Información Pública-, creándose la mencionada AGENCIA DE ACCESO A LA INFORMACIÓN PÚBLICA Y PROTECCIÓN DE LOS DATOS PERSONALES, como ente autárquico que funcionará con autonomía funcional en el ámbito de la JEFATURA DE GABINETE DE MINISTROS, y el CONSEJO FEDERAL PARA LA TRANSPARENCIA Y PROTECCIÓN DE DATOS PERSONALES, organismo interjurisdiccional de carácter permanente, como un espacio federal para la cooperación técnica y concertación de políticas públicas de transparencia y protección de datos personales.

Puede observarse que, si bien como todo proyecto es perfectible, el mismo es hábil para poner en discusión la necesidad de una reforma integral.

Desafíos para una regulación que garantice la efectiva protección de datos personales en contextos tecnológicos.

Como venimos señalando a lo largo del documento, los avances en el desarrollo de nuevas tecnologías y su uso cotidiano y extendido, han impactado de lleno en la protección de los datos personales, emergiendo nuevas formas de vulneraciones al derecho a la privacidad, anteriormente sólo pensadas en la ciencia ficción. Esto demanda modificar la ley 25.326, sancionada hace ya más de dos décadas.

La utilización de IA produce considerables riesgos a la protección de datos personales y más, cuando es generativa. Esto se debe a que, la misma combina grandes cantidades de datos con algoritmos, que le permiten aprender de patrones o cualidades de los datos y construir perfiles según características específicas. En otras palabras, el algoritmo necesita consumir innumerable cantidad de datos para aprender a predecir el comportamiento humano y producir resultados.

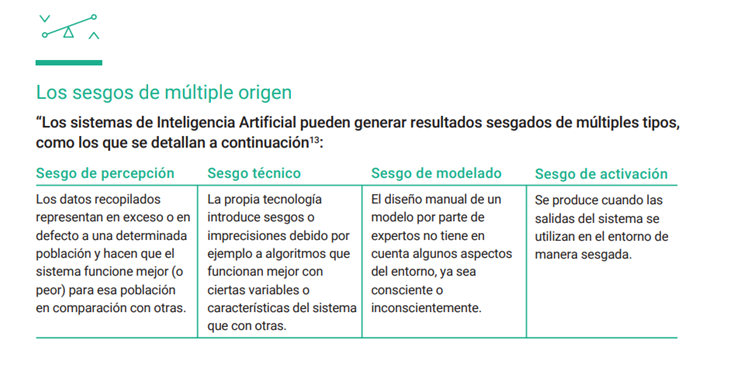

De esto se desprende la complejidad que presenta este tipo de tecnologías y la interacción que se producen con nuestros datos personales, a lo que se suma, que el algoritmo tiene sesgos, y generar perfiles sesgados no es baladí. Por lo que, es necesario traer a debate los sesgos algorítmicos presentes en las decisiones automatizadas y el derecho a no ser sometido a este tipo decisiones.

A ello se suma, la necesaria evaluación que, en los contextos digitales, la barrera entre lo público y lo privado se ha desdibujado. Esto genera un nuevo esquema de interrelación humana, y determina nuevas formas potenciales de vulneraciones, como son, los perfilamientos para incidir en las conductas o hasta modificarlas.

Las potencialidades de las IA generativas son innumerables, pero paralelamente plantea serios problemas a nivel jurídico, los cuales deben ser abordados por la legislación.

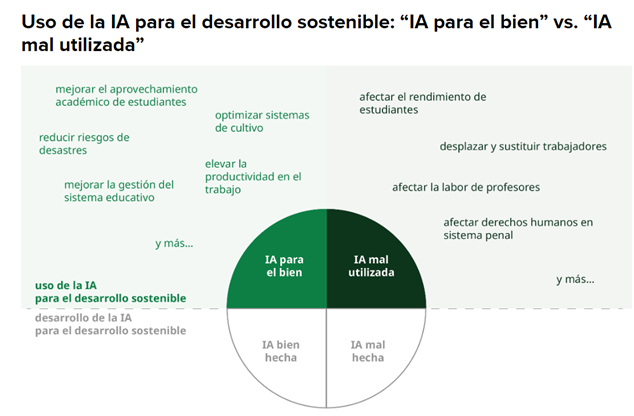

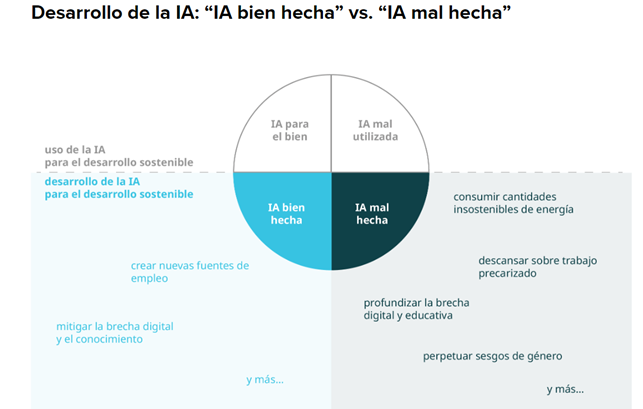

Es interesante el análisis del Laboratorio de Aceleración del Programa de las Naciones Unidas para el Desarrollo (PNUD) en México, que se propuso explorar cómo se puede aprovechar la inteligencia artificial generativa como motor para el desarrollo sostenible, y nos indica cuáles son las potencialidades y los riesgos del uso de la IA:

De esto se desprende que las oportunidades para beneficiar a las sociedades son muchas, pero también son muchos los riesgos cuando el desarrollo de la IA no cumple con ciertos parámetros y replica en consecuencias negativas para la vida de las personas. Ya señalamos las afrentas a la libertad, la privacidad y los riesgos de los sistemas de reconocimiento, a los que se suma, los peligros de los perfiles delictivos sobresesgados. Por ejemplo, se ha señalado que “Muchas investigaciones han demostrado que los sistemas de reconocimiento facial suelen tener una mayor tasa de error en la identificación de mujeres, especialmente mujeres de piel más oscura, en comparación con hombres de piel clara.”[22]

Pero, ¿qué pasa cuando estas tecnologías son utilizadas para influir en decisiones como una elección? ¿qué sucede con la democracia?

Y esto ya ha sucedido: “Pero más allá del caso principal por el cual se conoce a Cambridge Analytica, es menester traer a colación que la empresa también trabajó en la Argentina. Diversos medios masivos de comunicación, en septiembre de 2019, sacaron a la luz ciertos hechos sobre la actuación de la consultora en el país. El equipo de investigación de la revista Noticias entrevistó al último CEO de Cambridge Analytica, Julian Wheatland, quién confirmó que se realizaron trabajos en territorio argentino, entre ellos, la participación en una elección local. A su vez, Alexander Nix, ex CEO y fundador de la empresa, admitió bajo juramento en 2018 ante la Comisión de Asuntos Digitales del parlamento británico haber trabajado en una campaña “antikirchnerista”, pero no reveló la identidad de sus contratantes. Por otro lado, el periodista Hugo Alconada Mon, en una nota en el diario La Nación, desvela que el partido político Propuesta Republicana (PRO) contrató los servicios de Cambridge Analytica en la antesala de la campaña presidencial, aunque, sin embargo, el acuerdo no se llegó a concretar porque los equipos propios del partido político lograron obtener lo mismo que la empresa les ofrecía. Más allá de todo esto, nos encontramos nuevamente ante un uso de IA para recabar datos personales sin el consentimiento informado de los titulares. …. La fusión entre IA, intereses comerciales, elecciones y manipulación social es un combo explosivo que debe ser cuidadosamente abordado por el Estado.”[23]

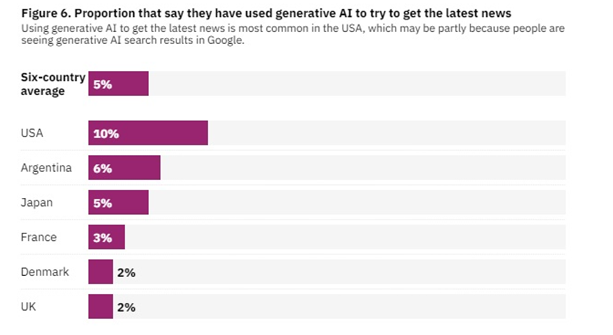

Por su parte, el Reuters Institute for the Study of Journalism, llevó a cabo un estudio de corte cuantitativo para conocer cómo el ciudadano usa la Inteligencia Artificial (IA) en su vida cotidiana y aplicada a las noticias. En la Argentina solo el 6% de los ciudadanos usó IA para acceder a las noticias, siendo el segundo de los países considerados en la muestra.

De esto se desprende la gravedad de la situación y el urgente tratamiento por parte del Honorable Congreso de la Nación. El derecho a la protección de los datos personales es un derecho humano, y no puede estar sujeto su ejercicio a una normativa desactualizada.

Los desafíos que presenta la proyección de una normativa actual, se presentan en diferentes planos. A nivel internacional, debe responder a los mejores estándares de protección de datos personales, y presentar coherencia y coordinación con la normativa a nivel regional.

A nivel local debe, por un lado, promover las ventajas de la tecnológica, y por el otro, velar por la protección de datos personales desde un enfoque de derechos humanos. Deben establecerse reglas claras que impulsen la innovación y el desarrollo tecnológico pero, que a su vez, proporcionen mayores niveles de protección a las personas.

El proyecto que destacamos en el presente informe, se presentaba como una buena oportunidad para debatir esos temas, y tenía ciertas previsiones que son destacables, pero lamentablemente está próximo a caducar, lo que imposibilita su tratamiento y demanda la presentación de uno nuevo.

Entre las cuestiones destacables, se encuentra, el principio de extraterritorialidad y su aplicación a cualquier tratamiento de datos personales, con independencia de las técnicas, procesos o tecnologías, actuales o futuras, que se utilicen para dicho efecto.

Asimismo, brega por el mentado punto de equilibrio al ampliar las posibilidades para el lícito tratamiento de datos personales, entre los que se incluye al interés legítimo. Recordemos que, para la legislación vigente, la única base legal es el consentimiento (con limitadas excepciones). Pero, a su vez, establece la minimización de datos y la responsabilidad proactiva como principios de procesamiento de datos.

En cuanto al consentimiento, el mismo sigue siendo un principio, pero se establecen parámetros para otorgarlo de manera más sencilla y clara, pero de manera expresa.

En igual sentido, establece bases legales para el tratamiento de datos sensibles, pero incluye que debe implementarse con responsabilidad reforzada, lo que implica mayores niveles de seguridad, confidencialidad, restricciones de acceso, uso y circulación.

En relación al tratamiento de datos personales de niñas, niños y adolescentes, no los prohíbe de manera genérica, pero determina que debe privilegiarse la protección del interés superior de éstos. Sí prohíbe por el contrario, el tratamiento en los juegos, aplicaciones, desarrollos e innovaciones tecnológicas, u otras actividades afines que involucren información personal, más allá de lo estrictamente necesario para la realización de la actividad.

Por otro lado, en esa búsqueda de equilibro, amplía las posibilidades de tratar los datos personales pero, se añaden nuevos derechos como portabilidad de datos, no estar sujeto a la toma de decisiones automatizada (o elaboración de perfiles), y obtener la limitación del tratamiento.

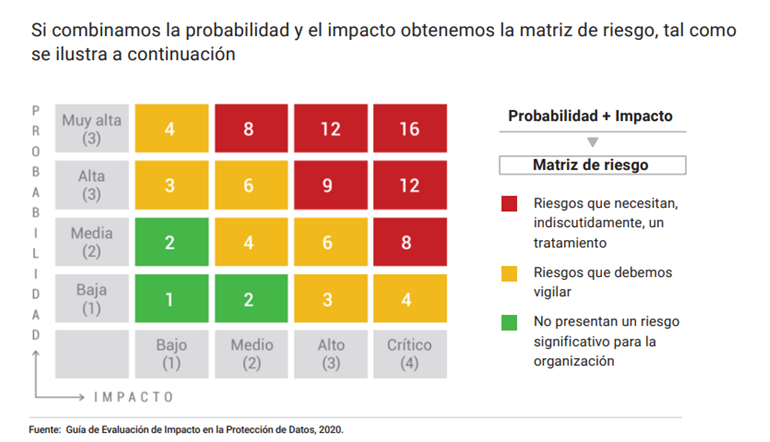

Asimismo, es destacable la realización de evaluación de impacto de la protección, como así también la creación del delegado de protección de datos. Todo esto teniendo en cuenta que “La relación entre los riesgos y la probabilidad de impacto permite construir una matriz de riesgo que permitirá anticipar si el sistema que se está diseñando es de alto, medio o bajo riesgo.”

Como todo proyecto puede ser objeto de observaciones: la primera de ellas tiene que ver con el tratamiento de datos por parte del Estado.

La iniciativa establece que la presente ley alcanza al tratamiento efectuado por el Estado con las finalidades de salvaguardar la seguridad pública, la defensa de la Nación, la protección de la salud pública y las libertades de terceros. Asimismo, señala cómo debe ser el tratamiento de datos por el sector público, incluyendo los casos de cesión.

Pero se eliminó del proyecto la mención al procesamiento de datos efectuado por las Fueras Armadas, de seguridad y de inteligencia que formaba parte del texto del ante proyecto, el cual establecía: “Esta ley es aplicable al tratamiento de datos personales efectuado por las Fuerzas Armadas, fuerzas de seguridad y de inteligencia. Cualquier medida que imponga una limitación a los derechos y garantías establecidos en la presente ley, debe ser necesaria y proporcional, tener en cuenta los intereses legítimos del Titular de los datos, establecer salvaguardias conforme a lo establecido en el artículo 35 de esta ley, y respetar los derechos fundamentales consagrados en la CONSTITUCIÓN NACIONAL”.

Claramente debe debatirse el texto suprimido: en el contexto actual, donde las Resoluciones del Ministerio de Seguridad N° 428/2024 y Nº 710/2024 dispusieron medidas de ciberpatrullaje y la creación de la Unidad de Inteligencia Artificial aplicada a la Seguridad (UIAAS), generan una honda preocupación por su afectación a las libertades individuales.

En otro orden, si bien el diseño institucional que propone el proyecto de reforma presentado por el otrora Ejecutivo Nacional, supera lo vigente, no es menos cierto que debería pensarse en una estructura independiente, dotada de mayores facultades. Asimismo, la información pública y la privacidad de datos se rigen por principios diversos. Englobarlos bajo la misma órbita, no sería lo aconsejable.

Debe apuntarse a un órgano de control independiente del Poder Ejecutivo, ello a fin de no frustrar las intenciones y el espíritu de la ley, pues el Estado es un sujeto obligado.

Además, al regular los derechos del titular de los datos, en el caso específico del derecho a la oposición, se establece que: “La persona Titular de los datos también puede oponerse al tratamiento de sus datos personales si tuvieran por objeto la publicidad, la prospección comercial o la mercadotecnia directa, incluida la elaboración de perfiles.” Y en esto, debería pensarse incluir específicamente la cuestión de la IA generativa.

En síntesis

Lo hasta aquí señalado someramente, pone en evidencia la importancia y la necesidad de que el Honorable Congreso de la Nación regule y llene el vacío legal existente, a fin de garantizar la protección de datos de las personas y el desarrollo y uso de las nuevas tecnologías en armonía con el ejercicio de los derechos humanos.

Una regulación tardía implica vulneración de derechos, por lo que desde IA 2050 pretendemos aportar al debate: en una sociedad como la que vivimos, la actualización de la Ley de Protección de Datos Personales es una obligación. Y si bien, ello no resulta suficiente, es un primer paso para que, posteriormente, las políticas públicas estén a la altura y establecer los mecanismos y acciones necesarias para lograr la protección real de los datos personales.

Se adjunta el proyecto referido, el cual se encuentra vigente hasta la finalización del presente período legislativo, es decir, hasta el 28 de febrero de 2025.

[1] https://www.ibm.com/es-es/topics/generative-ai

[2] https://adevinta.com/es/cuentos/articulos/inteligencia-artificial-generativa-que-es-como-funciona/

[3] https://www.meta.ai/

[4] https://amnistia.org.ar/en-argentina-3-de-cada-4-personas-estan-preocupadas-por-el-uso-de-los-datos-personales-que-hacen-las-grandes-companias-de-tecnologia/

[5] https://publicacionescientificas.uces.edu.ar/index.php/ratioiurisB/article/view/1406#:~:text=Se%20trata%20de%20una%20investigaci%C3%B3n%20en%20proceso,%20desarrollada%20con%20Paula

[6] https://www.cels.org.ar/web/2023/04/confirman-la-inconstitucionalidad-del-uso-del-sistema-de-reconocimiento-facial/#:~:text=La%20C%C3%A1mara%20de%20Apelaciones%20de%20la%20Ciudad%20de%20Buenos%20Aires

[7] https://www.mpf.gob.ar/pia/files/2023/04/Expte-228-22-resolucion-difusion-20-4-23.pdf#:~:text=irregularidad%20que%20detenta%20el%20accionar%20del%20Ministerio%20de%20Justicia%20y

[8] https://www.iciudad.org.ar/esta-autorizado-el-estado-de-la-ciudad-de-buenos-aires-para-acceder-a-informacion-personal-almacenada/#:~:text=Ante%20la%20noticia%20de%20que%20el%20Ministerio%20de%20Justicia%20y

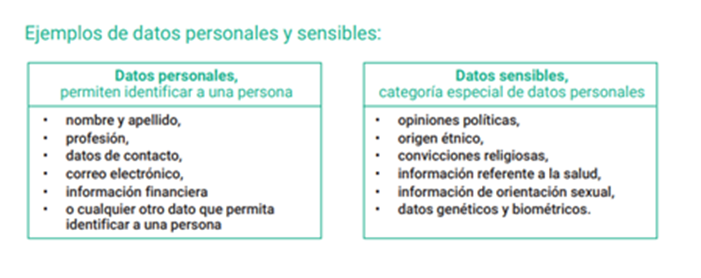

[9] Ley 25326, ARTICULO 2° (Definiciones): “A los fines de la presente ley se entiende por: … Datos sensibles: Datos personales que revelan origen racial y étnico, opiniones políticas, convicciones religiosas, filosóficas o morales, afiliación sindical e información referente a la salud o a la vida sexual.”

ARTICULO 7° (Categoría de datos): “1. Ninguna persona puede ser obligada a proporcionar datos sensibles.

2. Los datos sensibles sólo pueden ser recolectados y objeto de tratamiento cuando medien razones de interés general autorizadas por ley. También podrán ser tratados con finalidades estadísticas o científicas cuando no puedan ser identificados sus titulares. 3. Queda prohibida la formación de archivos, bancos o registros que almacenen información que directa o indirectamente revele datos sensibles. Sin perjuicio de ello, la Iglesia Católica, las asociaciones religiosas y las organizaciones políticas y sindicales podrán llevar un registro de sus miembros. 4. Los datos relativos a antecedentes penales o contravencionales sólo pueden ser objeto de tratamiento por parte de las autoridades públicas competentes, en el marco de las leyes y reglamentaciones respectivas.”

[10] CN, Artículo 19: “Las acciones privadas de los hombres que de ningún modo ofendan al orden y a la moral pública, ni perjudiquen a un tercero, están sólo reservadas a Dios, y exentas de la autoridad de los magistrados. Ningún habitante de la Nación será obligado a hacer lo que no manda la ley, ni privado de lo que ella no prohíbe.”

[11] https://www.argentina.gob.ar/sites/default/files/aaip-argentina-guia_para_usar_la_ia_de_manera_responsable.pdf

[12] https://www.argentina.gob.ar/normativa/nacional/resoluci%C3%B3n-428-2024-399894/texto

[13] https://www.argentina.gob.ar/normativa/nacional/resoluci%C3%B3n-710-2024-402139/texto

[14] https://www.argentina.gob.ar/sites/default/files/2018/10/hacia_una_nueva_ley_de_proteccion_de_datos_personales_-_vf.pdf

[15] https://www.argentina.gob.ar/aaip/datospersonales/proyecto-ley-datos-personales

[16] https://www.argentina.gob.ar/sites/default/files/2018/10/hacia_una_nueva_ley_de_proteccion_de_datos_personales_-_vf.pdf

[17] ARTÍCULO 1°.- Objeto. La presente Ley tiene por objeto garantizar el ejercicio del derecho fundamental de las personas humanas a la protección de sus datos personales y su privacidad, de conformidad con lo establecido en el artículo 43, párrafo Tercero de la CONSTITUCIÓN NACIONAL, los convenios internacionales que contengan disposiciones sobre protección de datos personales y los Tratados de Derechos Humanos en los que la REPÚBLICA ARGENTINA sea parte.

Esta Ley establece las reglas para el debido tratamiento de los datos personales y la autodeterminación informativa, así como los derechos de las personas humanas y los deberes de quienes realizan dicho tratamiento.

[18] Consentimiento. En el caso en que la base legal para el tratamiento de datos sea el consentimiento de la persona Titular de los datos, se requiere que este sea expreso, previo, libre, específico, informado e inequívoco, para una o varias finalidades determinadas, ya sea mediante una declaración o una clara acción afirmativa.

Se entiende por:

a) Previo, cuando se solicita el consentimiento antes de la recolección de los datos;

b) Expreso, cuando la persona Titular de los datos exterioriza su voluntad con una clara acción afirmativa;

c) Libre, cuando se encuentra exento de vicios -la persona Titular de los datos debe tener la opción de negarse a

otorgar su consentimiento sin sufrir perjuicio alguno-;

d) Específico, cuando, en el caso que el tratamiento tenga varios fines, la persona Titular de los datos se encuentra posibilitada de otorgar su consentimiento para cada uno de ellos;

e) Informado, cuando la persona Titular de los datos cuenta con la información establecida en el artículo 16 de

esta Ley;

f) Inequívoco, cuando no presente dudas sobre el alcance de la autorización otorgada por la persona Titular de los datos.

El Responsable de tratamiento debe ser capaz de demostrar que la persona Titular de los datos consintió el

tratamiento de sus datos personales.

[19] https://www.techopedia.com/es/definicion/ia-generativa

[20] https://www.argentina.gob.ar/sites/default/files/aaip-argentina-guia_para_usar_la_ia_de_manera_responsable.pdf

[21] https://www.undp.org/es/mexico/blog/navegando-las-posibilidades-de-la-ia-generativa-para-el-desarrollo-sostenible

[22] https://www.argentina.gob.ar/sites/default/files/aaip-argentina-guia_para_usar_la_ia_de_manera_responsable.pdf

[23] https://publicacionescientificas.uces.edu.ar/index.php/ratioiurisB/article/view/1406#:~:text=Se%20trata%20de%20una%20investigaci%C3%B3n%20en%20proceso,%20desarrollada%20con%20Paula

Desde allí acceder al archivo PDF

[24] https://observatoriodemedios.uca.edu.ar/en-la-argentina-hay-buena-opinion-del-uso-de-ia-en-las-noticias/

[25] https://www.argentina.gob.ar/sites/default/files/2018/10/hacia_una_nueva_ley_de_proteccion_de_datos_personales_-_vf.pdf

[26] https://www.argentina.gob.ar/sites/default/files/aaip-argentina-guia_para_usar_la_ia_de_manera_responsable.pdf